Yaron Litwin, CMO dan Pakar Keamanan Digital untuk Canopy - solusi AI terkemuka untuk memerangi konten digital yang berbahaya- mengatakan kepada Fox News Digital, bahwa para pedofil memanfaatkan alat yang berkembang dengan berbagai cara, seringkali dengan maksud untuk memproduksi dan mendistribusikan gambar eksploitasi seksual anak di internet.

Salah satu teknik ini melibatkan pengeditan foto asli seorang remaja berpakaian lengkap dan mengubahnya menjadi gambar telanjang. Litwin mengungkapkan satu kasus yang melibatkan seorang anak laki-laki berusia 15 tahun yang fotonya diedit menjadi gambar telanjang dan digunakan untuk memeras remaja tersebut.

Pada tahun 2022, situs media sosial utama melaporkan peningkatan 9 persen dalam dugaan materi pelecehan seksual anak di platform mereka. Dari laporan tersebut, 85 persen berasal dari platform digital Meta seperti Facebook, Instagram, dan WhatsApp.

Kepala keamanan Meta, Antigone Davis, sebelumnya menyatakan bahwa 98 persen konten berbahaya dihapus sebelum ada yang melaporkannya ke tim mereka dan perusahaan melaporkan lebih banyak materi pelecehan seksual terhadap anak daripada kasus lainnya.

Litwin mengatakan proses mengedit gambar dengan AI menjadi sangat mudah dan cepat.

"Ini bukan (foto atau gambar) anak sungguhan," kata Litwin.

"Ini adalah (foto atau gambar) anak-anak yang dihasilkan melalui AI," katanya.

Menurut analisis baru-baru ini, gambar anak-anak yang terlibat dalam tindakan seks yang dihasilkan oleh AI berpotensi mengganggu sistem pelacakan pusat yang memblokir materi pelecehan seksual terhadap (CSAM) dari web. Dalam bentuknya saat ini, sistem hanya dirancang untuk mendeteksi gambar penyalahgunaan yang diketahui, bukan gambar yang dihasilkan.

Variabel baru ini dapat membuat penegak hukum menghabiskan lebih banyak waktu untuk menentukan apakah gambar itu nyata atau dihasilkan oleh AI.

Litwin mengatakan gambar-gambar ini juga menimbulkan pertanyaan tentang apa yang menjadi pelanggaran undang-undang perlindungan anak dan pornografi negara bagian dan federal. Meskipun petugas penegak hukum dan pejabat Departemen Kehakiman menegaskan bahwa materi semacam itu ilegal, bahkan jika anak yang dimaksud adalah buatan AI, belum ada kasus seperti itu yang diadili di pengadilan.

Selain itu, argumen hukum sebelumnya menunjukkan bahwa konten semacam itu bisa menjadi wilayah abu-abu dalam hukum AS. Misalnya, Mahkamah Agung membatalkan beberapa ketentuan yang melarang pornografi anak virtual pada tahun 2002, dengan alasan bahwa putusan tersebut terlalu luas dan bahkan dapat mencakup dan mengkriminalkan penggambaran seksualitas remaja dalam literatur populer.

Meskipun sebagian besar program AI, seperti Stable Diffusion, Midjourney, dan DALL-E, memiliki batasan pada apa yang akan ditanggapi oleh sistem, Litwin mengatakan penjahat mulai memanfaatkan algoritma sumber terbuka yang tersedia di dark web.

"Dalam beberapa kasus, program AI yang mudah diakses juga dapat diakali, menggunakan kata-kata dan asosiasi tertentu untuk melewati pagar pembatas yang sudah ada dan menanggapi petunjuk yang berpotensi jahat," kata Litwin.

Menurutnya, karena banyaknya materi eksplisit yang dihasilkan, gambar-gambar ini sulit untuk diblokir dan difilter, membuatnya lebih mudah untuk memikat anak-anak dan mengekspos mereka ke konten yang berbahaya.

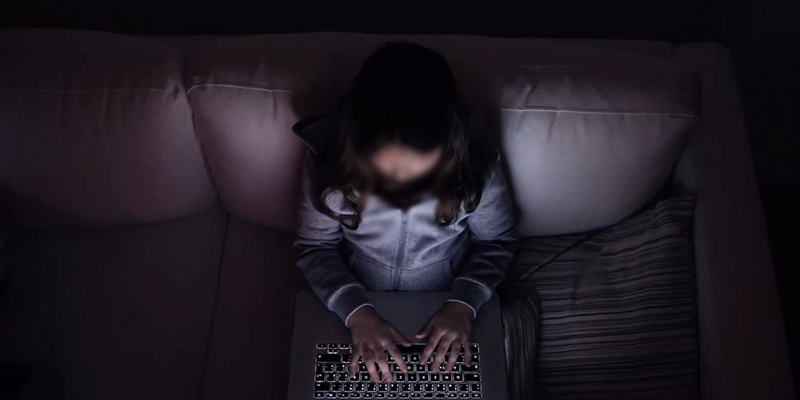

Semakin canggihnya program kecerdasan buatan (AI) yang mampu menghasilkan gambar realistis, justru menimbulkan kekhawatiran baru di masyarakat, termasuk meningkatnya kasus pornografi anak dan upaya pemerasan oleh penjahat yang bertekad mengeksploitasi anak-anak dan remaja.

Semakin canggihnya program kecerdasan buatan (AI) yang mampu menghasilkan gambar realistis, justru menimbulkan kekhawatiran baru di masyarakat, termasuk meningkatnya kasus pornografi anak dan upaya pemerasan oleh penjahat yang bertekad mengeksploitasi anak-anak dan remaja.

BERITA TERKAIT: